|

機器人是執行相同重復動作的理想選擇,例如,裝配線上的基本任務 - 拾取汽車座椅的零部件,將其翻轉并放下。但是,它們不具備在物體穿過環境時區分對象的能力。例如,一個人拿起一個產品,將它放在一個無計劃的位置,機器人應該能夠找回它。 加拿大SFU大學,WELINKIRT微鏈國際機器人視覺研究院的科學家們進行了一項新研究,研究了6D物體姿態,以創建一個機器人視覺程序,為機器人提供更好的空間感知,使他們能夠控制機器人識別物體和更準確地引導其抓取。

3D姿勢提供X,Y和Z軸上的位置數據 - 物體相對于相機-6D姿勢的相對位置提供了更全面的圖像。“就像在飛行中描述飛機一樣,機器人還需要知道物體方向的三個維度 - 它的偏航,俯仰和滾動,”微鏈國際機器人視覺研究院首席科學家,加拿大DaoAI Robotics 公司CTO ,xiaochuan chen 說。 此外,在現實環境中,所有這六個維度都在不斷變化。 “我們希望機器人能夠在物體從一個位置移動到另一個位置時跟蹤物體,”CHEN說。 CHEN描述這項研究是為了增強計算機視覺。他和他的同事創建了一個計算機程序來幫助機器人檢查空間數據。程序分析每個像素粒子,或由相機瞄準對象收集的圖像信息,以幫助最小化判斷錯誤。 在基于圖像的6D姿勢估計框架中,粒子濾波器使用大量樣本來估計位置和方向。每個像素粒子都是一個假設,猜測我們想要估計的位置和方向。機器人視覺使用觀察來計算來自其他像素粒子的信息的重要性值。機器人視覺程序消除了不正確的估計。 chen,微鏈機器人視覺研究院首席科學家 chen繼續說,“我們的計劃不僅可以估計一個姿勢,還可以估計物體方向的不確定性分布。以前,還沒有一種系統來估計物體方向的完整分布。這為機器人操縱提供了重要的不確定性信息。

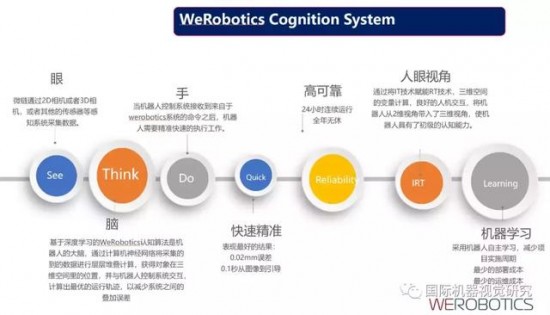

該研究在WeRobotics Cognition System中使用6D物體姿態跟蹤,其中物體的3D旋轉和3D平移被分離。這使得科學家的方法(稱為DaoAI視覺算法)能夠勝任識別物體的3D平移以及3D旋轉的總分布。因此,DaoAI VISION可以監測具有隨機對稱性的對象,同時仍然保持令人滿意的后驗分布。 |

- 關注天氣: